Im KI-Markt gab es lange einen klaren Gewinner: Nvidia. Genau das stellt Google jetzt offen infrage.

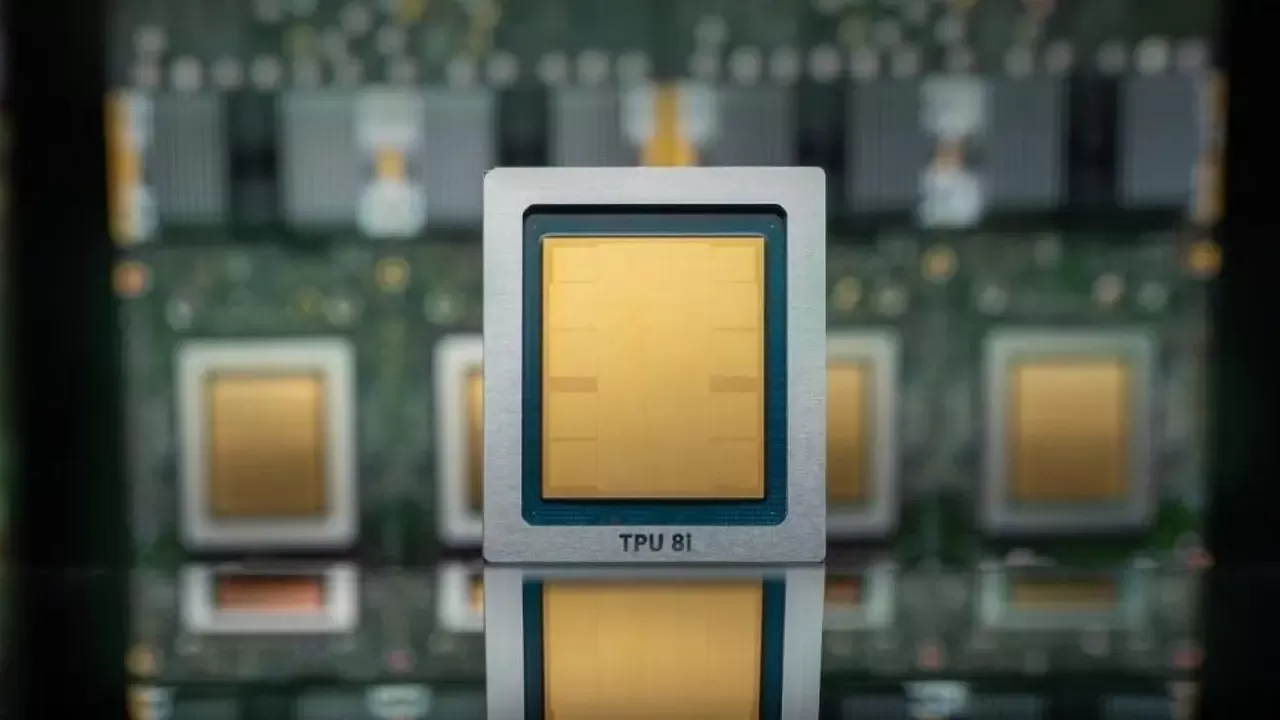

Mit den neuen Cloud TPU 8t und TPU 8i bringt der Konzern zwei eigene Chips an den Start – einen für das Training großer Modelle, einen für schnelle Inferenz. Der Ansatz ist klar: weniger Abhängigkeit von Nvidia, mehr Kontrolle über die eigene KI-Infrastruktur.

👉 Die entscheidende Frage ist nicht mehr, ob Google mithalten kann – sondern wie stark diese Chips im Alltag wirklich sind.

Direkte Antwort: Google Cloud hat zwei neue KI-Chips vorgestellt: TPU 8t für das Training großer Modelle und TPU 8i für schnelle Inferenz. Beide sind speziell für den Einsatz in der Google Cloud entwickelt und sollen in bestimmten Szenarien leistungsfähiger und effizienter als klassische Nvidia-GPUs sein.

TPU 8t vs. TPU 8i: Der eigentliche Unterschied

Google entwickelt seine eigenen TPUs schon lange – aber mit der neuen Generation wird der Unterschied erstmals wirklich relevant. Der TPU 8t ist für das Training großer KI-Modelle gedacht. Also genau für die Phase, in der Modelle entstehen und enorme Rechenleistung brauchen. Hier will Google vor allem bei Kosten und Energieverbrauch punkten – zwei Bereiche, in denen Nvidia bisher kaum Konkurrenz hatte. Der TPU 8i geht in eine andere Richtung: Er ist für die Inferenz optimiert. Bedeutet: Modelle sind bereits trainiert und müssen schnell und effizient Antworten liefern – etwa bei Chatbots oder KI-Tools im Alltag.

👉 Und genau hier wird es spannend: schnellere Antworten, geringere Kosten und skalierbare Infrastruktur für Unternehmen.

📋 Quick Facts

- TPU 8t: Fokus auf Training großer KI-Modelle

- TPU 8i: Optimiert für schnelle Inferenz

- Beide nur über Google Cloud verfügbar

- Ziel: Alternative zu Nvidia H100, H200 und kommenden Generationen

Googles Strategie: Weniger Nvidia, mehr Kontrolle

Mit den neuen TPUs verfolgt Google ein klares Ziel: Unternehmen sollen in der Cloud keinen zwingenden Grund mehr haben, auf Nvidia-Hardware zu setzen. Das ist vor allem eine Kostenfrage. Nvidia-GPUs gelten als leistungsstark – aber auch als teuer und schwer skalierbar. Genau hier setzt Google an und bietet eine eigene Alternative innerhalb der Cloud. Der entscheidende Vorteil liegt im Gesamtpaket: Hardware, Software und Infrastruktur kommen aus einer Hand. Mit Frameworks wie JAX und TensorFlow sowie direkten KI-APIs entsteht ein Ökosystem, das vor allem für Unternehmen attraktiv ist, die keine eigene KI-Infrastruktur aufbauen wollen. Sollte sich das durchsetzen, könnte Nvidia im Cloud-Geschäft erstmals ernsthaft unter Druck geraten.

👉 Für viele bedeutet das: weniger Komplexität, geringere Kosten – und mehr Kontrolle über die eigenen KI-Anwendungen.

Technische Architektur: Warum das überhaupt relevant ist

Technische Architektur: Warum das überhaupt relevant ist

Die neue TPU-Generation setzt genau da an, wo moderne KI-Modelle ihre größte Last haben: bei der Verarbeitung von Transformer-Architekturen. Google hat dafür die Matrix-Berechnungseinheiten grundlegend überarbeitet. Das klingt technisch – macht aber im Alltag einen Unterschied: Modelle lassen sich schneller trainieren und effizienter betreiben. Beim TPU 8t spricht Google von bis zu 3,5-facher Effizienz gegenüber der Vorgängergeneration bei typischen Trainingsaufgaben. Der TPU 8i zielt auf die andere Seite: Inferenz. Hier sollen die Antwortzeiten im Vergleich zu klassischen Cloud-GPUs um bis zu 40 % sinken.

👉 Wichtig: Direkte Vergleiche mit aktuellen Nvidia-Chips fehlen noch. Wie groß der Unterschied wirklich ist, werden erst unabhängige Tests zeigen.

🔍 Auf einen Blick

Google TPU 8t und 8i sind keine klassischen Allround-Chips, sondern spezialisierte KI-Beschleuniger für die Cloud.

Ihr Ziel ist klar: bessere Effizienz, niedrigere Kosten – und weniger Abhängigkeit von Nvidia.

✍️ Was bedeutet das konkret?

Für Unternehmen, die bereits auf Google Cloud setzen, ist das ein echter Hebel.Statt Nvidia-GPUs zu mieten, können sie auf Googles eigene Hardware wechseln – mit engerer Integration und potenziell niedrigeren Kosten. Gerade für Startups und Teams, die eigene KI-Modelle trainieren oder betreiben, kann das schnell relevant werden. Gleichzeitig steigt der Druck auf Nvidia. Denn Google ist nicht allein: Auch Amazon und Microsoft bauen eigene Chips. Die Richtung ist klar – mehr Konkurrenz im Cloud-KI-Markt.

👉 Trotzdem bleibt Nvidia stark. Vor allem wegen CUDA – das Ökosystem ist nach wie vor ein entscheidender Vorteil.

Häufige Fragen (FAQ)

Was ist der Unterschied zwischen TPU 8t und TPU 8i?

Der TPU 8t ist für Training ausgelegt – also maximale Leistung für große Modelle. Der TPU 8i übernimmt die Inferenz: schnelle Antworten bei möglichst niedriger Latenz.

Sind TPUs besser als Nvidia-GPUs?

In bestimmten Cloud-Szenarien ja – vor allem bei Effizienz und Kosten. Nvidia bleibt dafür vielseitiger und hat mit CUDA das stärkere Ökosystem.

Wann sind die Chips verfügbar?

Teilweise schon im Early Access. Ein globaler Rollout erfolgt schrittweise über die Google Cloud.

Welche Frameworks laufen darauf?

Am besten JAX und TensorFlow. PyTorch funktioniert auch, aber nicht ganz so reibungslos wie auf Nvidia-Systemen.

Das Wichtigste in Kürze

- Google bringt eigene KI-Chips als direkte Alternative zu Nvidia

- Fokus liegt klar auf Cloud-Workloads (Training + Inferenz)

- Effizienz und Kosten könnten sich deutlich verbessern

- Konkurrenz im KI-Markt nimmt spürbar zu

✍️ Einschätzung

Google macht mit den neuen TPUs deutlich: Abhängigkeit von Nvidia ist kein Naturgesetz mehr.

Der Ansatz ist logisch – eigene Hardware, tief integriert in die Cloud, optimiert für genau die Workloads, die heute zählen. Wenn das in der Praxis hält, was Google verspricht, könnte sich der Markt spürbar verschieben. Aber: Noch fehlen echte Vergleichswerte. Und solange CUDA der Standard bleibt, wird Nvidia nicht so schnell verdrängt.

👉 Die entscheidende Frage ist deshalb nicht, ob Google aufholt – sondern wie schnell Unternehmen bereit sind zu wechseln.

Quelle: ShiftDelete.Net