Gemini auf dem Pixel 10 wird agentic – und bucht jetzt Uber für dich

Google erweitert Gemini auf dem Pixel 10 um Screen Automation: Die KI bedient Apps selbstständig und bucht zum Beispiel Uber-Fahrten – mit Nutzerbetätigung vor dem Abschluss.

Google hat Gemini auf dem Pixel 10 einen deutlichen Schritt weiter gebracht. Die sogenannte Screen Automation erlaubt es der KI, Apps eigenständig zu bedienen – ohne dass der Nutzer jeden Schritt selbst ausführen muss. Uber buchen, Essen bestellen, Kaffee vorbestellen: Gemini erledigt das jetzt auf Wunsch allein. Das ist kein futuristisches Versprechen mehr, sondern läuft seit dem April-Update auf allen Pixel-10-Modellen.

Was kann Screen Automation genau?

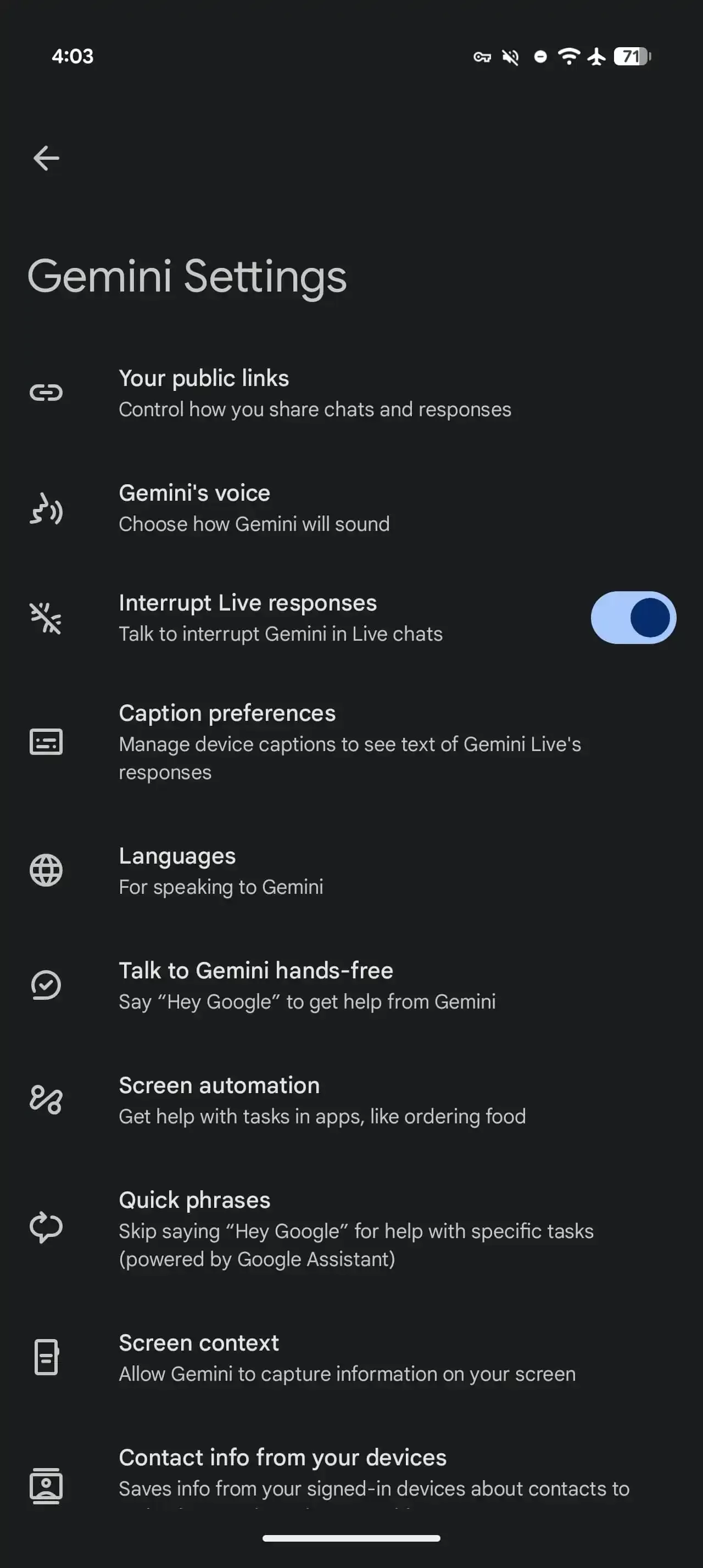

Das Feature versteckt sich in den Gemini-App-Einstellungen unter "Screen Automation". Dort können Nutzer festlegen, für welche Apps Gemini aktiv werden darf. Unterstützt werden bisher: Uber, Lyft, Uber Eats, DoorDash, Grubhub und Starbucks. Der Ablauf ist simpel: Man sagt Gemini, was man möchte – zum Beispiel "Bestell mir bei DoorDash eine Pizza" – und die KI öffnet die App, wählt das Produkt aus, gibt die Adresse ein und zeigt die Bestellübersicht. Erst dann muss der Nutzer einmal tippen, um die Aktion abzuschließen. Das ist wichtig: Gemini schließt keine Transaktionen ohne Bestätigung ab.

Warum ist das wichtig?

Warum ist das wichtig?

Das heißt: Agentic AI – KI, die nicht nur antwortet, sondern handelt – kommt endlich auf Mainstream-Geräten an. Bislang war so etwas nur in Entwickler-Demos oder spezialisierten Apps zu sehen. Dass Google das direkt auf dem Pixel integriert, ist ein starkes Signal. Das Pixel-Ökosystem bekommt damit ein Feature, das kein anderes Android-Gerät in dieser Form hat – zumindest vorerst. Samsung-Nutzer können sich auf eine breitere Einführung freuen, der Rollout auf Galaxy-Geräten wurde ebenfalls angekündigt.

Was bedeutet das für Nutzer?

Praktisch bedeutet das: Wer viel Uber oder DoorDash nutzt, spart sich repetitive Klickpfade. Man öffnet die App nicht mehr selbst, navigiert nicht durch Menüs – man sagt einfach, was man will. Für Menschen mit eingeschränkter Mobilität ist das sogar echte Barrierefreiheit. Der Vorbehalt bleibt aber: Die App-Liste ist noch sehr kurz. Wer kein Uber, Lyft oder Starbucks nutzt, hat vorerst wenig davon. Ob und wann weitere Apps folgen, hängt von der Entwickler-API ab, die Google bereitstellt.

Wann kam das Feature?

Screen Automation wurde mit dem April-2026-Update für alle Pixel-10-Modelle freigeschaltet – also Pixel 10, 10 Pro, 10 Pro XL und 10 Pro Fold. Ältere Pixel-Modelle sind nicht unterstützt. Samsung hat angekündigt, das Feature in einem späteren Update für Galaxy-Geräte zu bringen, einen konkreten Zeitplan gibt es aber noch nicht.

Technische Details

Die Screen Automation basiert auf Gemini Nano, dem on-device KI-Modell im Pixel 10. Das bedeutet: Alle Aktionen laufen lokal, ohne Daten an Googles Server zu senden. Gemini liest den Bildschirminhalt aus und navigiert durch App-UIs wie ein menschlicher Nutzer. Eine Bestätigung ist vor jeder abschließenden Aktion (z.B. Zahlung) Pflicht. Die Funktion lässt sich pro App aktivieren oder deaktivieren. Die aktuell unterstützten Apps: Uber, Lyft, Uber Eats, DoorDash, Grubhub, Starbucks.

Vergleich mit der Konkurrenz

Apple hat mit Siri Shortcuts und App Intents zwar ähnliche Konzepte, aber keine vergleichbare In-App-Automation durch eine KI. Microsoft Copilot auf Windows versucht ebenfalls, Workflows zu automatisieren – läuft aber auf einem anderen Use Case. Das Android-16-April-Update hat zusätzlich zu Screen Automation auch einen Desktop Mode gebracht, der das Pixel 10 zum Mini-PC macht. Außerdem zeigt der Pixel 10a mit Isai Blue-Farbe, wie breit das Pixel-Lineup gerade aufgestellt ist.

Redaktionsmeinung

Ich finde Screen Automation genuinen Fortschritt – aber ich bin gleichzeitig vorsichtig. Eine KI, die in meinem Namen Bestellungen platziert, hat Zugriff auf meine Apps, meine Adresse, meine Zahlungsdaten. Google sagt, alles läuft lokal ab und ohne Bestätigung passiert nichts. Das klingt gut. Aber die Frage ist, wie lange bis Entwickler diese API für Zwecke nutzen, die weniger klar im Interesse des Nutzers sind. Vorerst ist die Feature-Liste kurz genug, um das zu kontrollieren. Der echte Test kommt, wenn die App-Liste wächst.

Kommentare (0)

Kommentar verfassen

Noch keine Kommentare vorhanden. Seien Sie der Erste, der kommentiert!